-

Notifications

You must be signed in to change notification settings - Fork 3

Batch Normalization

warmwall edited this page Sep 28, 2019

·

8 revisions

Batch Normalization(배치 정규화): 미니배치 단위로 데이터 분포를 정규화하여 각 층의 활성화를 적당히 퍼트리도록 강제하는 방법

배치 정규화의 장점

- 학습 속도 개선

- 초깃값에 의존하지 않음: 초깃값을 잘 설정하지 않아도 각 층의 활성화값 분포가 고르게 된다

- 오버피팅 억제: 드롭아웃 등의 필요성 감소

배치 정규화 방법

- 미니배치의 데이터 분포가 평균이 0, 분산이 1이 되도록 정규화를 수행한다.

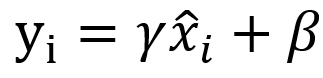

- 아래 식에 따라 데이터의 확대 및 이동을 수행한다.

- γ는 데이터의 확대를, β는 데이터의 이동을 담당한다.

- 초기값은 γ는 1, β은 0으로 지정한다. 학습하면서 적당한 값으로 조정해 나간다.

- 밑바닥부터 시작하는 딥러닝 6장